La documentation existe-t-elle encore ? La question mérite d’être posée. Le terme disparaît de la plupart des diplômes, les formations type IUT se transforment au point de dissoudre et de passer le document de l’état solide à l’état gazeux au bénéfice d’une communication attirante pour les étudiants, mais dont les soubassements actuels teintés de marketing d’influence, d’absence d’éthique et de bidouillage en tout genre n’incitent pas à l’optimisme.

Le capes de documentation est totalement vidé de son socle disciplinaire épistémologique et didactique. Dernier inventaire avant liquidation définitive et transformation dans un rôle de garant de la bonne morale et de la bonne gestion. Que fallait-il attendre au final après avoir été une discipline scolaire occupée par les tenants de la discipline au sens des bonnes cases, des emplois du temps bien ordonnés et des panoptiques du learning-glanding center.

Les professions corrélées à la documentation n’intéressent peu ou plus à l’exception peut-être des bibliothèques qui évacuent toute dimension scientifique un peu sérieuse au profit d’une animation de surface qui prolonge surtout les industries du livre et de l’édition. Les considérations en matière d’information scientifique et technique sont jugées caduques ou trop techniques. Le triomphe d’une culture éloignée de toute considération technologique et scientifique s’avère une catastrophe qui explique la médiocre qualité scientifique de nombreux ouvrages en bibliothèque. Je passe sur le fait que même dans les BU le travail de sélections des ouvrages pertinents pour les disciplines n’est plus vraiment effectué. Cette mission essentielle de documentation s’évanouit peu à peu au profit des mètres carrés qui célèbrent plus les architectes que le travail de documentation.

Le documentaliste est bientôt mort ou bien l’est-il déjà ? Je ne sais plus trop qu’espérer si ce n’est que la situation n’est désormais pas simplement grave, elle est totalement désespérée. On est très loin des débats du passé où on avait défendu à plusieurs reprises le capes de documentation et la profession de professeur-documentaliste.

Tous les mauvais choix ont été faits. Toutes les décisions politiques ont été mortifères jusqu’au duo infernal EMC-EMI dont on avait pourtant rappelé à plusieurs reprises le funeste destin que cela promettait à la documentation. Les résistances ont de plus en plus été faibles au gré des départs à la retraite des principaux activistes tandis que complaisances et petites satisfactions ont achevé le tout.

La documentation est aux enfers désormais dans un contexte politique et médiatique qui ne peut que lui être néfaste.

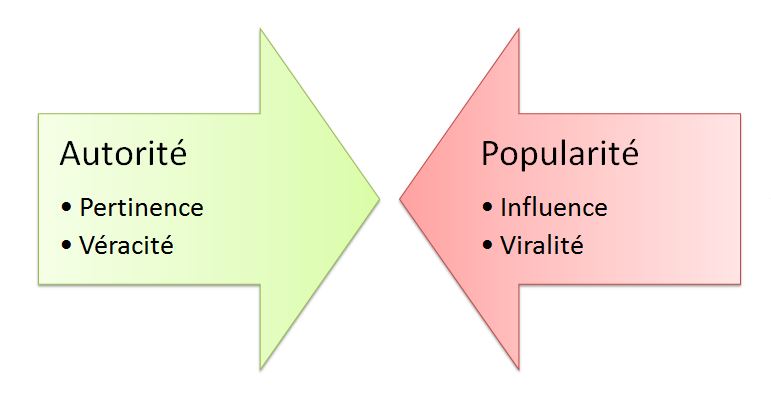

On lui a préféré depuis des décennies le concept polysémique et problématique d’information qui a fini par être galvaudé au point que des médias d’information dans le paysage audiovisuel français produisent de la déformation des esprits en masse, sans prendre la peine de sourcer et de documenter quoi que ce soit. L’époque est à l’influence face à la pertinence, à la popularité face à l’autorité (scientifique), au c’est à voir face au savoir… ce n’est pas faute d’en avoir expliqué les mécanismes et les risques dès 2006 avec la transformation de l’écosystème numérique et médiatique. Pas faute d’avoir montré les risques conspirationnistes que cela pouvait générer. Mais encore aurait-il fallu déjà considérer les travaux dans les sciences de l’information et de la documentation comme digne d’intérêt. Chose finalement peu aisée quand le CNRS n’a jamais vraiment reconnu la discipline et paradoxalement encore moins les sciences de la documentation que la communication. Pourtant l’histoire du CNRS début clairement avec comme mission la défense de la documentation scientifique. Peut-être faudra-t-il un jour repartir sur ses bases.

Alors que faire ? Faut-il sauver l’Eurydice documentaire ? Faut-il continuer à expliquer l’importance du document dans les processus actuels, convaincre de la pertinence de l’hyperdocumentation ? Rappeler que c’est un philosophe Maurizio Ferraris qui a osé en faire un concept fondamental alors que nous n’osions le faire ? Poursuivre les travaux en épistémologie alors que tout le monde s’excite sur un concept d’IA dont on n’est pas du tout certain de l’acuité ?

J’avais affiché il y a quelques mois mon pessimisme dans une série de questions pour le prochain Mediadoc. J’espérais me tromper. C’est encore pire que ce que je m’imaginais.

Se priver de la documentation épistémologiquement, pédagogiquement et techniquement, c’est courir le risque de plus comprendre grand-chose et de ne voir les choses qu’à moitié.

C’est devenir borgne.